Deep generative models

•

Generative adversarial network (GAN)

◦

암묵적 추정. 확률분포를 따르는 샘플들을 생성하도록 함.

•

Autoregressive models

◦

명시적 추정 (분포의 parameter를 학습하기 때문), 정확한 분포 추정.

◦

이미 생성된 자신의 데이터 일부를 조건으로 하여 다음 데이터를 생성함.

◦

잠재변수 모델이 아니다!

•

Variational autoencoders (VAEs)

◦

명시적 추정 (분포의 parameter를 학습하기 때문), 근사적 분포 추정 (정규분포)

◦

잠재변수 z의 분포를 정규분포로 근사한다.

•

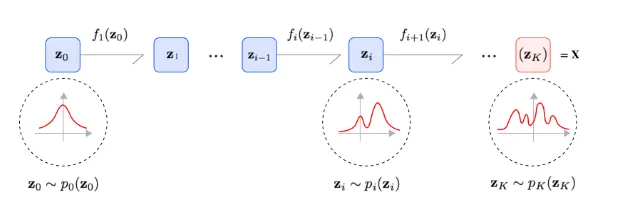

Flow model

◦

단순한 확률 분포에 여러 단계의 변환을 수행하여 복잡한 분포를 만드는 방법

◦

변환 함수의 역함수가 존재해야 하기 때문에, 모델을 만들 때 사용하는 연산자에 제한이 있다.

•

Energy-based modeling

◦

데이터가 살고 있는 공간 근처는 낮은 에너지를 부여한다!

•

Score matching → 여기서 score는 수리통계학 score function에서 왔다

◦

Likelihood-based 모델이나, GAN 같은 implicit model들의 단점 → likelihood computation을 위한 tractable normalizing constant를 보장해야 하기 때문에 모델 구조에 제약이 있다.

◦

“Score” → Log-probability density distribution의 gradient

Progress in diffusion probabilistic models

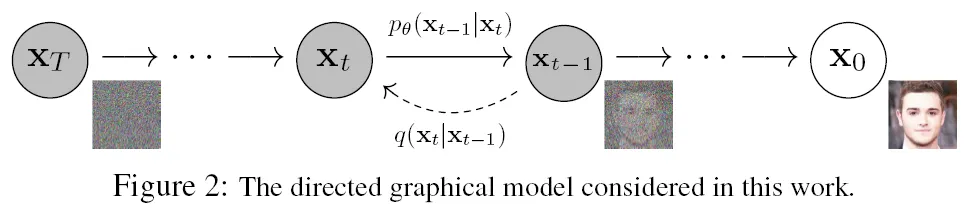

Diffusion 모델은 초기 상태의 분자들이 점차 흩어지는 것을 나타내는 랑주뱅 동역학(Langevin dynamics)에서 아이디어를 가져왔다. 사진의 픽셀들이 시간이 지나면서 흩어져서(노이즈가 껴서) 결국 노이즈로 변하는 것을 수식을 통해 나타내는 것이다.

•

정방향 변환 (forward) : 데이터가 노이즈로 변하는 것

•

역방향 변환 (reverse) : 노이즈가 데이터로 변하는 것

확산 모델에서는 역변환 단계를 파라미터화하여 딥러닝 모델로 학습하고, 학습된 역변환을 이용해서 노이즈로부터 데이터를 생성한다. 파라미터화된 Markov chain이라고 볼 수 있다!

학습에는 negative log-likelihood의 Evidence lower bound (ELBO)를 사용한다.